相机中的自己是真正的样子吗(一个一直被误解的认知)

这是一个古老但依然有很多人在讨论的话题,大多数人的直觉都是我们的眼睛远强于相机,但直觉显然还不够靠谱,今天小胖就跟大家从视角、分辨率和感光度/动态范围度来简单对比一下吧。

首先是视角,相机的视角取决于所采用的镜头,所以相机的第一个优势出现了,一台相机可以有很多不同的视角,而人眼就是“变焦只能靠走”。但人眼有自己的特点:第一,人眼是球体,视细胞(上图Retina组成部分之一)是弧形分布,所以严格来说不能按平面传感器来定义焦距(但顺便解决了场曲的问题);第二,远离中央凹窝(上图Fovea)之外的视觉锐度会急剧下降,余光覆盖范围的分辨率其实很低,比如你很难用余光来读书,甚至都很难看清余光里走来的人长什么样子,顶多能知道有个人来了,可能可以分辨出性别,仅此而已;第三,人眼是双眼成像,而相机是“单眼”。

每一只眼睛包含余光的视角是120-200度,双眼同时覆盖的区域是130度左右,但我们只靠转动眼球就能直接看到的范围在40-60度左右,这就是为什么总有人说人眼视角在约等于标准定焦镜头(43-50mm左右)的原因,而全画幅11mm镜头视角是126度左右。

因为人眼是双眼成像,再加上有“脑补”,所以人眼没有畸变,晶状体的进化也已经基本抹除了球差,不过人眼存在比较明显的色差,但大脑这个强劲的“机内处理器”把它给脑补掉了。而相机镜头几乎没有办法避免各种像差的影响,机内修正也是路漫漫其修远兮,广角镜头的边缘还会有明显的拉伸,当然,可以通过拼接等方式来改善。所以双眼再加大脑,在相同的广角视野上人眼有着无可比拟的性能优势。

其次是分辨率,人眼的分辨率其实并不高,而且不少人都存在散光、近/远视等病变问题,即便是最佳状态下的人眼,也不可能完全记录所有的场景细节,比如我凌乱的书桌上摆了一瓶饮料,如果只看个1/100秒或者摆得太远,我是看不清配方表的。人眼处理细节的方式依然取决于大脑对场景自动产生的兴趣区域,比如这张照片:

男性看脸看身材,女性看发型眉形唇彩衣服包包,当然大家也都会注意到左下角的品牌LOGO,这时候我再问你“她戴的配饰有蝴蝶样式么?”你一定会回过头去放大照片来找,而这个对比其实就是人眼与相机在分辨率和细节上的呈现方式差异:人眼会根据兴趣来关注重点区域,大多数时候回忽略很多细节,视觉只是我们思维的起点,看同一个场景每一个人都会萌生出不同的情感和想法。而相机则是忠实记录场景,通过相机我们可以还原现场非常多的细节,甚至是人眼无法直接观测的细节,比如微距、比如长焦。

第三是动态范围,很多人都觉得人眼在动态范围上远高于传感器,这里借用 AIRPHOTO定义新视觉 大神一张照片来说明好了,侵删:

左侧是RAW原片,右侧是最终调整后,人眼的效果虽然没有办法直接呈现,但并不会是右图的效果,注意:右图并没有二次创作,而是纯粹从原片中调整而来。所以,在讨论人眼与相机的动态范围问题时,很多人都犯了“过于直观”的错误,比如出隧道时,外面强烈的阳光和昏暗的隧道内部的对比,瞳孔会在观察不同位置时自动缩放,直接与单次曝光的照片来对比并不公平(而且人眼动态范围非常主观,甚至因人而异,所以很难量化,容易造成误解)。

目前的全画幅相机动态范围可以做到近15档,就像上面的对比图,通过后期处理,相机同样可以强吃动态范围,在强力显示器下非常出色地还原现场(其实这时候显示器依然是瓶颈),并且根据主观喜好来改变色调风格,所以我并不认为相机在这方面会输。

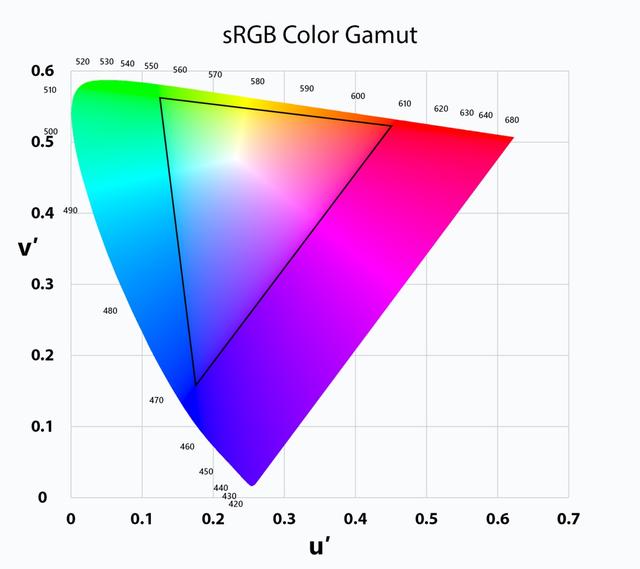

理论上来说,目前主流规范的色域覆盖远远不如可见光谱,即便是Rec.2020,也只覆盖了可见光谱的57.3%,照片处理常用的sRGB/Adobe RGB甚至只有33.3%/38.8%,所以理论上人眼对颜色的识别度会明显更宽,但目前在图像处理上也有一些相对专业处理方式,比如在RAW处理时,第一步就把色彩空间设置为ProPhoto 16bit/通道:

可以看到,ProPhoto色彩空间在绿色和蓝色端甚至部分超出了可见光谱的范畴,事实上不少传感器的光谱响应范围也是如此(如下图,超过可见光谱的800nm波长也依然有超40%的量子效率),换句话说就是RAW文件的色彩覆盖是很充裕的,所以RAW处理的一个大前提是尽量在最后才转换为sRGB等色域,以免从开头就把色深限制到了8bit,也就限制了调整空间,产生杂色和断层,影响细节。

但对于人眼来说,颜色的敏感度又是一个“人人皆有不同”的实际问题,人眼对绝对色调的判断是非常不准的(尤其是男性,所以别掏支口红出来问我这是啥色号的),不过用作色调对比倒是很敏感,一般来说1~2nm的波长人眼都能观察出来(如果把2个哪怕颜色极为接近的口红摆在一起,也还是能看出区别的),而且每个人的情况还不太一样(色盲色弱),因此在照片后期处理得当的情况下,很多人并不能看出两者的区别。

最后说说灵敏度,在弱光的环境下,人眼会主动降低分辨率(黑漆漆的屋子里你没办法阅读),会丢掉色彩(黑漆漆的屋子里看啥都是黑白),只能模糊辨识物体,在自己熟悉的环境里还可以根据记忆来辅助判断。而传感器的优势在于可按需定制,灵敏度阈值(信噪比超过1的电信号所需的光子数)可以通过增大像素面积来降低,而且曝光时长可控,所以即便是在极弱光环境下,只要控制好暗电流,相机依然有办法照度0.01lux以内(没有月光的晚上),实现黑白或彩色内容的输出。比如博世的IP Starlight 8000MP监控摄像机,彩色3K/全高清分辨率可以0.0121lux/0.00825lux,黑白3K/全高清甚至可以低至0.004lux/0.00275lux,在这种照度下可以输出30p帧率视频,而且这只是一颗1/1.8英寸前照式CMOS而已。

PS:说到这就顺便插个话题,低像素总数/单个像素大面积的优势是单像素阱容更大,灵敏度阈值下限更低,有利于极弱光环境(比如森林防火、库房监控、深水/深空遥感等等),但在灵敏度阈值以上的光照环境下,相同尺寸传感器采用高像素总数的设计可以通过缩图来弥补信噪比/动态范围差距,并且分辨率与锐度更具优势。所以什么“A7S系列弱光强于A7R系列”就属于纯吹水,强调过多次,遇到过许多木工米青,就不再多回复这类评论了。

总结来说,相机产生的照片是以满足视觉美感而来的,人眼的性能并不一定强于相机,两者的比较其实难以做到公平,两者也都会受到不少的客观限制,或许这个话题永远都难以有一个服众的定论,但我现在的理解就是今天这样,欢迎理性讨论。

,免责声明:本文仅代表文章作者的个人观点,与本站无关。其原创性、真实性以及文中陈述文字和内容未经本站证实,对本文以及其中全部或者部分内容文字的真实性、完整性和原创性本站不作任何保证或承诺,请读者仅作参考,并自行核实相关内容。文章投诉邮箱:anhduc.ph@yahoo.com