jeff机器学习(JeffDean等人新作换个角度审视语言模型)

机器之心报道

编辑:陈萍

这是一篇来自谷歌、斯坦福大学、北卡罗来纳大学教堂山分校以及 DeepMind 四个机构的研究,论文从「涌现(emergence)」的角度介绍大模型,所谓的涌现,即有些现象不存在于较小的模型中但存在于较大的模型中。

近年来,语言模型对自然语言处理 (NLP) 产生了革命性影响。众所周知,扩展语言模型,例如参数等,可以在一系列下游 NLP 任务上带来更好的性能和样本效率。在许多情况下,扩展对性能的影响通常可以通过扩展定律进行预测,一直以来,绝大多数研究者都在研究可预测现象。

相反,包括 Jeff Dean 、 Percy Liang 等在内的 16 位研究者合作的论文《 Emergent Abilities of Large Language Models 》,他们讨论了大模型不可预测现象,并称之为大型语言模型的涌现能力( emergent abilities)。所谓的涌现,即有些现象不存在于较小的模型中但存在于较大的模型中,他们认为模型的这种能力是涌现的。

涌现作为一种想法已经在物理学、生物学和计算机科学等领域讨论了很长时间,本论文从涌现的一般定义开始,该定义改编自 Steinhardt 的研究,并植根于 1972 年诺贝尔奖获得者、物理学家 Philip Anderson 的一篇名为 More Is Different 的文章。

本文探讨了模型规模的涌现,通过训练计算和模型参数来衡量。具体而言,本文将大型语言模型的涌现能力定义为在小规模模型中不存在、但在大规模模型中存在的能力;因此,大型模型不能通过简单地推断小规模模型的性能改进来进行预测。该研究调查了在一系列先前工作中观察到的模型涌现能力,并将它们进行分类:小样本提示和增强提示等设置。

模型的这种涌现能力激发了未来的研究,即为什么会获得这些能力,以及更大的规模是否会获得更多的涌现能力,并强调了这项研究的重要性。

论文地址:https://arxiv.org/pdf/2206.07682.pdf

小样本提示任务

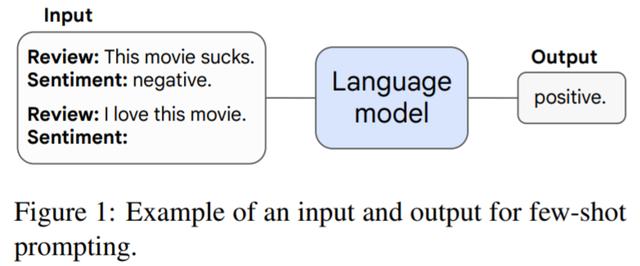

本文首先讨论了提示范式中的涌现能力。例如在 GPT-3 提示中,给出预训练语言模型任务提示,模型无需进一步训练或对参数进行梯度更新即可完成响应。此外,Brown 等人提出了小样本提示,他们将模型上下文(输入)中的一些输入输出示例作为提示(preamble),然后要求模型执行未见过的推理任务。图 1 为一个提示示例。

当模型具有随机性能且具有一定规模时,通过小样本提示就可以执行任务,这时涌现能力就会出现,之后模型性能远远高于随机性能。下图展示了 5 个语言模型系列(LaMDA、GPT-3、Gopher、Chinchilla 以及 PaLM )的 8 种涌现能力。

BIG-Bench:图 2A-D 描述了来自 BIG-Bench 的四个涌现小样本提示任务,BIG-Bench 是一个由 200 多个语言模型评估基准的套件。图 2A 显示了一个算术基准,它测试了 3 位数字的加减法,以及 2 位数字的乘法。表 1 给出了 BIG-Bench 更多涌现能力。

增强提示策略

目前来看,尽管小样本提示是与大型语言模型交互的最常见方式,但最近的工作已经提出了其他几种提示和微调策略,以进一步增强语言模型的能力。如果一项技术在应用到一个足够大的模型之前没有显示出改进或者是有害的,本文也认为该技术也是一种涌现能力。

多步推理(Multi-step reasoning):对于语言模型和 NLP 模型来说,推理任务,尤其是那些涉及多步推理的任务一直是一个很大的挑战。最近有一种名为思维链(chain-of-thought)提示策略,通过引导语言模型在给出最终答案之前生成一系列中间步骤,从而使它们能够解决这类问题。如图 3A 所示,当扩展到 1023 次训练 FLOP(~ 100B 参数)时,思维链提示只超过了没有中间步骤的标准提示。

指令( Instruction following ):如图 3B 所示,Wei 等人发现,当训练 FLOP 为 7 · 10^21 (8B 参数)或更小时,指令微调(instruction-finetuning)技术会损害模型性能,在将训练 FLOP 扩展到 10^23 (~100B 参数)时才能提高性能。

程序执行( Program execution ):如图 3C 所示,在 8 位加法的域内评估中,使用暂存器仅有助于 ∼9 · 10^19 个训练 FLOP(40M 参数)或更大的模型。图 3D 显示这些模型也可以泛化到域外 9 位加法,它出现在 ∼1.3 · 10^20 个训练 FLOPs(100M 参数)。

本文讨论了语言模型的涌现能力,到目前为止,仅在一定的计算规模上才能观察到有意义的性能。模型的这种涌现能力可以跨越各种语言模型、任务类型和实验场景。这种涌现的存在意味着额外的规模扩展可以进一步扩大语言模型的能力范围。这种能力是最近发现的语言模型扩展的结果,关于它们是如何出现的,以及更多的扩展是否会带来更多的涌现能力,可能是NLP领域未来重要的研究方向。

更多内容,请参考原论文。

,

免责声明:本文仅代表文章作者的个人观点,与本站无关。其原创性、真实性以及文中陈述文字和内容未经本站证实,对本文以及其中全部或者部分内容文字的真实性、完整性和原创性本站不作任何保证或承诺,请读者仅作参考,并自行核实相关内容。文章投诉邮箱:anhduc.ph@yahoo.com